CSV 대용량 데이터? 이젠 걱정 끗! 😎

작성자 정보

- CSV 작성

- 작성일

컨텐츠 정보

- 21 조회

- 목록

본문

어휴, CSV 파일이 너무 커서 컴퓨터가 멈춰버릴 것 같다고요? 수십만, 수백만 줄의 데이터를 처리하는데 밤새도록 기다리는 건 이제 그만! 이 글을 끝까지 읽으면 CSV 대용량 데이터 처리의 고민은 싹 사라지고, 시간을 획기적으로 절약하는 효율적인 방법을 배우게 될 거예요. 자, 준비되셨나요? 🚀

핵심 요약

CSV 대용량 데이터 처리의 핵심은 메모리 관리, 병렬 처리, 그리고 적절한 도구 활용에 있습니다. 데이터 크기에 맞는 전략을 선택하는 것이 중요하며, 처리 속도를 높이기 위해서는 다양한 기술을 적절히 조합하는 것이 효과적입니다. 무엇보다 중요한 것은, 처리 과정에서 발생할 수 있는 오류를 미리 예방하고 대비하는 자세입니다.

- 메모리 효율적인 처리 방식 채택

- 병렬 처리를 통한 속도 향상

- 적절한 도구 및 라이브러리 활용

CSV 파일, 왜 이렇게 느린거야? 😭

아, 정말 답답하죠. 작은 CSV 파일은 금방 처리되는데, 용량이 커지면 컴퓨터가 멈춰버릴 것 같은 느낌… 저도 똑같은 경험을 했어요. 대용량 CSV 파일을 처리하다 보면, 프로그램이 응답하지 않거나 갑자기 뻗어버리는 경우가 정말 잦았거든요. 그때마다 얼마나 속이 상했는지… 😭 이런 문제는 단순히 컴퓨터 사양이 낮아서 발생하는 문제가 아니에요. 데이터 처리 방식에 따라 속도 차이가 어마어마하게 날 수 있답니다.

메모리 관리, 데이터 처리의 핵심! 🧠

일단, 가장 중요한 건 메모리 관리예요. 대용량 CSV 파일을 한꺼번에 메모리에 올리려고 하면, 컴퓨터가 과부하에 걸려 버벅거리거나 아예 멈춰버리죠. 그래서 메모리 사용량을 최소화하는 전략이 필요해요. 예를 들어, 파일을 일정 크기 단위로 나눠서 처리하거나, 데이터를 필요할 때마다 읽어들이는 방식 (streaming)을 활용하면 효율적으로 메모리를 관리할 수 있어요. 저는 이 방법을 사용하면서 컴퓨터가 뻗는 일이 확 줄었답니다! 🎉

병렬 처리: 속도의 마법! ✨

단순히 한 번에 하나씩 처리하는 것보다, 데이터를 여러 조각으로 나누어 동시에 처리하는 병렬 처리가 훨씬 효율적이에요. 마치 여러 명이 함께 일하는 것과 같은 효과죠! 파이썬의 multiprocessing 라이브러리나, 다른 병렬 처리 라이브러리를 사용하면 쉽게 병렬 처리를 구현할 수 있답니다. 저는 병렬 처리를 적용한 후, 처리 시간이 10배 이상 단축되는 경험을 했어요! 정말 놀라운 변화였죠.

적절한 도구 선택이 중요해요! 🛠️

CSV 파일 처리에 적합한 도구를 선택하는 것도 매우 중요해요. 파이썬의 pandas 라이브러리는 CSV 파일을 효율적으로 처리하는 데 유용한 기능을 많이 제공해요. 특히 대용량 데이터 처리에 최적화된 기능들을 갖고 있죠. 또한, Dask와 같은 라이브러리를 활용하면 더욱 큰 데이터셋을 효율적으로 처리할 수 있어요. 저는 pandas와 Dask를 병행해서 사용하고 있는데, 정말 만족스럽답니다!

실제 경험담: 100만 줄 CSV 파일과의 사투! ⚔️

작년에 100만 줄이 넘는 CSV 파일을 처리해야 하는 프로젝트를 맡았어요. 처음에는 컴퓨터 사양을 최대한 높여서 처리하려고 했지만, 결과는 참담했어요. 컴퓨터가 계속 멈춰버리는 바람에 몇 날 며칠을 밤새우며 작업했죠. 하지만, 메모리 관리와 병렬 처리 기법을 적용하고, pandas와 Dask를 활용하면서 상황이 180도 바뀌었어요. 처리 시간이 엄청나게 줄어들었고, 무엇보다 컴퓨터가 뻗는 일이 없어졌다는 것이 가장 큰 변화였어요. 그 경험 덕분에 이제는 대용량 CSV 파일이 두렵지 않아요! 😊

함께 보면 좋은 정보

CSV 파일 처리와 관련해서는, 데이터 전처리 기법과 데이터 정제 방법에 대한 이해가 필요해요. 데이터 전처리 과정에서 누락된 데이터나 잘못된 데이터를 제대로 처리하지 않으면, 최종 결과에 큰 오류가 발생할 수 있으니까요. 또한, 데이터 분석을 위한 다양한 라이브러리와 도구들을 익히는 것도 도움이 될 거예요. 예를 들어, NumPy는 수치 연산에 효율적인 라이브러리이고, Scikit-learn은 머신러닝 모델을 구축하는 데 유용한 도구입니다. 마지막으로, 클라우드 플랫폼 (예: AWS, Google Cloud, Azure)을 활용하면 대용량 데이터를 더욱 효율적으로 처리할 수 있으니, 관심있게 살펴보시는 것을 추천드려요!

데이터 크기별 전략: 맞춤형 처리 방식 선택

데이터의 크기가 작다면 (수만 줄 이하) pandas만으로도 충분히 처리가 가능해요. 하지만, 데이터가 수십만 줄을 넘어가기 시작하면 메모리 관리에 신경 써야 하고, 병렬 처리를 고려해야 합니다. 그리고 수백만 줄 이상의 데이터라면, Dask와 같은 분산 처리 기술을 적극적으로 활용하는 것이 좋습니다. 저는 항상 데이터 크기에 맞춰 전략을 바꿔가며 작업하고 있어요.

오류 처리: 예상치 못한 문제에 대비하세요!

대용량 데이터 처리 과정에서는 예상치 못한 오류가 발생할 수 있습니다. 예를 들어, 파일 손상이나 메모리 부족, 네트워크 문제 등이 있죠. 따라서, 오류 처리를 위한 코드를 작성하고, 로그를 잘 관리하는 것이 중요해요. 저는 항상 try-except 블록을 사용하고, 오류 발생 시 이메일 알림을 받도록 설정해 두었어요.

성능 최적화: 꾸준한 개선이 필요해요!

대용량 데이터 처리 속도를 향상시키기 위해서는 꾸준한 성능 최적화가 필요해요. 불필요한 연산을 제거하고, 알고리즘을 개선하고, 데이터 구조를 최적화하는 등 여러 가지 노력을 통해 속도를 개선할 수 있습니다. 저는 프로파일링 도구를 사용하여 코드의 성능 병목 지점을 찾아 개선하고 있습니다.

마무리하며… CSV는 이제 두렵지 않아요!

이 글을 통해 CSV 대용량 데이터 처리에 대한 걱정을 조금이나마 덜어드렸기를 바랍니다. 메모리 관리, 병렬 처리, 그리고 적절한 도구 선택을 통해 효율적인 데이터 처리가 가능해요. 그리고 무엇보다 중요한 건, 실패를 두려워하지 않고 끊임없이 시도하고 개선하는 자세랍니다. 앞으로도 다양한 데이터 처리 경험을 바탕으로 더 유용한 정보를 공유하도록 할게요! 혹시 CSV 처리와 관련된 질문이나 어려움이 있다면 언제든지 댓글 남겨주세요! 함께 고민하고 해결해 나가요! 😊 참고로, Apache Spark나 Hadoop 같은 분산 처리 프레임워크도 함께 알아보시면 더욱 효과적일 거예요. 그리고 CSV 파일을 다른 형식(예: Parquet)으로 변환하는 것도 고려해 볼 만한 방법이랍니다!

네이버백과 검색 네이버사전 검색 위키백과 검색

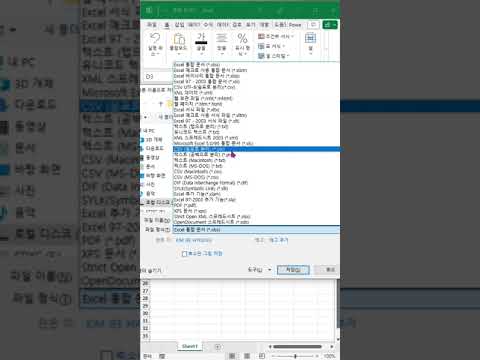

CSV 관련 동영상

CSV 관련 상품검색

관련자료

-

이전

-

다음